一、神经网络的特点

1.信息处理的并行性、信息存储的分布性、信息处理单元的互联性、结构的可塑性

人工神经网络是由大量简单处理元件相互连接构成的高度并行的非线性系统,具有大规模并行性处理特性。虽然每个处理但与的功能十分简单,但是大量简单处理单元的并行活动使网络呈现出丰富的功能并具有较快的速度。结构上的并行性使网络的信息存储必然采用分布方式,即信息不是存储在网络的某个局部,而是分布在网络所有的连接权中。一个神经网络可存储多种信息,其中每个神经元的连接权中存储的使多种信息的一部分。当需要获得已存储的知识时,神经网络在输入信息激励下采用“联想”的方法进行回忆,因而具有联想记忆功能。神经网络内在的并行性与分布性表现在其信息的存储与处理在空间分布、时间上都是并行的。

2.高度的非线性、良好的容错性和计算的非精度性

神经元的广泛互联与并行工作必然使整个网络呈现出高度的非线性特点。而分布存储的结构特点会使网络在两个方面表现出良好的容错性:一方面,由于信息的分布式存储,当网络中部分神经元损坏时不会对系统的整体性能造成影响,这就象人脑海中每天都有神经细胞正常死亡而不会影响大脑的功能一样;另一方面,当输入模糊、残缺或变形的信息时,神经网络能通过联想恢复记忆,从而实现对不完整输入信息的正确识别,这一点就像人可以对不规范的手写字进行正确识别一样。神经网络能够处理连续的模拟信号以及不精确的、不完全的模糊信息,因此给出的是次优的逼近解而非精确解。

3.自学习、自组织与自适应性

自适应性是指一个系统能够改变自身的性能以适应环境变化的能力,它是神经网络的一个重要特性。自适应性包括自学习与自组织两层含义。神经网络的自学习是指当外界环境发生变化时,经过一段时间的训练或感知,神经网络能够通过自动调整网络结构参数,使得对于给定输入能产生期望的输出,训练时神经网络学习的途径,因此经常将学习与训练两个词混用。神经系统能在外部刺激下按一定规则调整神经元之间的突触连接,逐渐构建神经网络,这一构建过程称为网络的自组织(或称重构)。神经网络的自组织能力与自适应性相关,自适应性是通过自组织实现的。

二、神经网络的基本功能

1.联想记忆

由于神经网络具有分布存储信息和并行计算的特性,因此它具有对外界刺激信息和输入模式进行联想记忆的能力。这种能力通过神经元之间的协同结构以及信息处理的集体行为而实现。神经网络是通过其突触权值和连接结构来表达信息的记忆,这种分布式存储使得神经网络能存储较多的复杂模式和恢复记忆的信息。神经网络通过预先存储信息和学习机制进行自适应训练,可以从不完整的信息和噪声干扰中恢复原始的完整信息,这一能力使其在图像复原、图像和语音识别、分类方面具有巨大的潜力。

联想记忆有两种基本形式:自联想记忆与异联想记忆。

(1)自联想记忆

网络中预先记忆多种模式信息,当输入某个已存储模式的部分信息或带有噪声干扰的信息时,网络能通过动态联想过程回忆起该模式的全部信息。

(2)异联想记忆

网络中预先存储了多个模式对,每一对模式均由两部分组成,当输入某个模式的一部分时,即使输入信息时残缺的或叠加了噪声的,网络也能回忆起与起对应的另一个部分。

2.非线型映射

在客观世界中,许多系统的输入与输出之间存在复杂的非线型关系,对于这类系统,往往很难用传统的数理方法建立其数学模型。设计合理的神经网络通过对系统输入输出样本对进行自学习,能够以任意精度逼近任意复杂的非线性映射。神经网络的这一优良特性使其可以作为多维非线型函数的通用数学模型。该模型的表达是非解析的,输入与输出数据之间的映射规则由神经网络在学习阶段自动抽取并分布式存储在网络的所有连接中。具有非线型映射功能的神经网络应用十分广泛,几乎涉及所有领域。

3.分类与识别

神经网络对外界输入样本具有很强的识别与分类能力。对输入样本的分类实际上是在样本空间找出符合分类要求的分割区域,每个区域内的样本属于一类。传统分类方法只适合解决同类相聚,异类分离的识别与分类问题。但客观世界中许多事物(例如不同的图像、声音、文字等等)在样本空间上的区域分割曲面是十分复杂的,相近的样本可能属于不同的类,而远离的样本可能同属于一类。神经网络可以很好的解决对非线型曲面的逼近,因此比传统的分类器具有更好的分类与识别能力。

4.优化计算

优化计算是指在已知约束条件下,寻找一组参数组合,使由该组合确定的目标函数达到最小值。某些类型的神经网络可以把待求问题的可变参数设计为网络的状态,将目标函数设计为网络的能量函数。神经网络经过动态演变过程达到稳定状态时对应的能量函数最小,从而其稳定状态就是问题的最优解。这种优化计算不需要对目标函数求导,其结果是网络自动给出的。

5.知识处理

知识是人们从客观世界的大量信息以及自身的实践中总结出来的经验、规则和判据。当知识能够用明确定义的概念和模型进行描述时,计算机具有极快的处理速度和很高的运算速度。而在很多情况下,知识常常无法用明确的概念和模型表达,或者概念的定义十分模糊,甚至解决问题的信息不完整、不全面,对于这类知识处理问题,神经网络获得知识的途径与人类似,也是从对象的输入输出信息中抽取规律而获得关于对象的知识,并将知识分布在网络的连接中予以存储。神经网络的知识抽取能力使其能够在没有任何先验知识的情况下自动从输入数据中提取特征、发现规律,并通过自组织过程构建网络,使其适合于表达所发现的规律。另一方面,人的先验知识可以大大提高神经网络的知识处理能力,两者的结合会使神经网络智能得到进一步提升。

三、信息处理领域的应用

1.信号处理

神经网络广泛应用于自适应信号处理和非线性信号处理中。前者如信号的自适应滤波、时间序列预测、谱估计、噪声消除等;后者如非线性滤波、非线性预测、非线性编码、调制/解调等。第一个成功实例就是电话线中回声消除,其他还有雷达回波的多目标分类、运动目标的速度估计、多探测器的信息融合等。

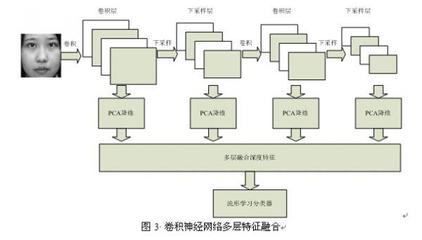

2.模式识别

模式识别设计模式的预处理和将一种模式映射为其他类型的操作,神经网络在这两方面都有许多成功的应用。神经网络不仅可以处理静态模式如固定图像、固定能谱等,还可以处理动态模式如视频图像、连续语音等。静态模式识别的成功例子有手写字的识别,动态模式识别成功的例子有语音信号识别。

3.数据压缩

神经网络对数据提取模式特征,只将该特征传出(或存储),接收后(或使用时)再将其恢复成原始模式。

爱华网

爱华网