SVM有如下主要几个特点:

(1)非线性映射是SVM方法的理论基础,SVM利用内积核函数代替向高维空间的非线性映射;

(2)对特征空间划分的最优超平面是SVM的目标,最大化分类边际的思想是SVM方法的核心;

(3)支持向量是SVM的训练结果,在SVM分类决策中起决定作用的是支持向量;

(4)SVM 是一种有坚实理论基础的新颖的小样本学习方法。

它基本上不涉及概率测度及大数定律等,因此不同于现有的统计方法。

从本质上看,它避开了从归纳到演绎的传统过程,实现了高效的从训练样本到预报样本的“转导推理”,

大大简化了通常的分类和回归等问题;

(5)SVM 的最终决策函数只由少数的支持向量所确定,计算的复杂性取决于支持向量的数目,

而不是样本空间的维数,这在某种意义上避免了“维数灾难”。

(6)少数支持向量决定了最终结果,这不但可以帮助我们抓住关键样本、“剔除”大量冗余样本,

而且注定了该方法不但算法简单,而且具有较好的“鲁棒”性。

这种“鲁棒”性主要体现在:

①增、删非支持向量样本对模型没有影响;

②支持向量样本集具有一定的鲁棒性;

③有些成功的应用中,SVM 方法对核的选取不敏感

两个不足:

(1) SVM算法对大规模训练样本难以实施由于SVM是借助二次规划来求解支持向量,

而求解二次规划将涉及m阶矩阵的计算(m为样本的个数),当m数目很大时该矩阵的存储和计算

将耗费大量的机器内存和运算时间。

针对以上问题的主要改进有

J.Platt的SMO算法、

T.Joachims的SVM、

C.J.C.Burges等的PCGC、

张学工的CSVM

以及O.L.Mangasarian等的SOR算法

(2) 用SVM解决多分类问题存在困难

经典的支持向量机算法只给出了二类分类的算法,

而在数据挖掘的实际应用中,一般要解决多类的分类问题。

可以通过多个二类支持向量机的组合来解决。

主要有

一对多组合模式、一对一组合模式和SVM决策树;

再就是通过构造多个分类器的组合来解决。

主要原理是克服SVM固有的缺点,结合其他算法的优势,解决多类问题的分类精度。

如:

与粗集理论结合,形成一种优势互补的多类问题的组合分类器。

转载 支持向量机的优缺点 支持向量机的应用实例

更多阅读

转载 总结DFN-LOW算法在图论中的应用 tarjan dfn和low

原文地址:总结DFN-LOW算法在图论中的应用作者:OIer_fc总结DFN-LOW算法在图论中的应用北京大学许若辰 长沙市雅礼中学 屈运华摘要: 在一个连通图[1]G中,有些点一旦被去除就会导致图不连通,同样的,有些边一旦被去除也会导致图G失去连通性,

转载 秋天的怀念《转载窦桂梅的教学设计》 秋天的怀念教学设计

原文地址:秋天的怀念《转载窦桂梅的教学设计》作者:天路秋天的怀念教学预设:1.在“秋天”的故事中,理解“母爱”的内涵。2.在“怀念”的情意中,感受“爱母”的思绪。3.在“秋天的怀念”中,获得“好好活”的思考。教学层次:走进母亲怎样

转载 美国科幻电影的常见主题浅析 浅析无主题变奏

[转载]美国科幻电影的常见主题浅析[1]A Brief Analysis onthe Frequently SeenSubjects in American Science FictionMovies原作:易李弘扬Summary:On the basis of aclassification of the frequently seen science fiction element

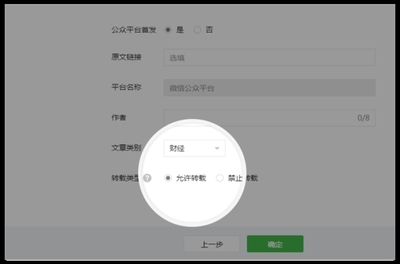

转载一篇CUUS的文章,与你们分享 微信公众平台转载文章

http://blog.renren.com/blog/347938411/897015467转载一篇CUUS的文章,与你们分享UWS 华盛顿西雅图大学,在去年12.1号前一直是我的dream school,也是我的‘目标’。虽然后来沦为safety,但阻挡不了我对他的热爱。不巧,最近在CUUS上看

转载 VB程序开发电缆挂牌制作中的应用 电缆挂牌

原文地址:VB程序开发电缆挂牌制作中的应用作者:hgg_wjVB程序开发电缆挂牌制作中的应用【摘要】电缆敷设是电缆工程施工中的重头戏,从检测、入库、运输再到敷设,要规范每一道工序,项目部都严格做好记录。在检测阶段,安质员严格测试电缆的

爱华网

爱华网![[转载]支持向量机的优缺点 支持向量机的应用实例](http://img.aihuau.com/images/01111101/01024534t010b6f785bd313b784.gif)